Opera integra ChatGPT, Claude e outras IAs ao navegador Neon

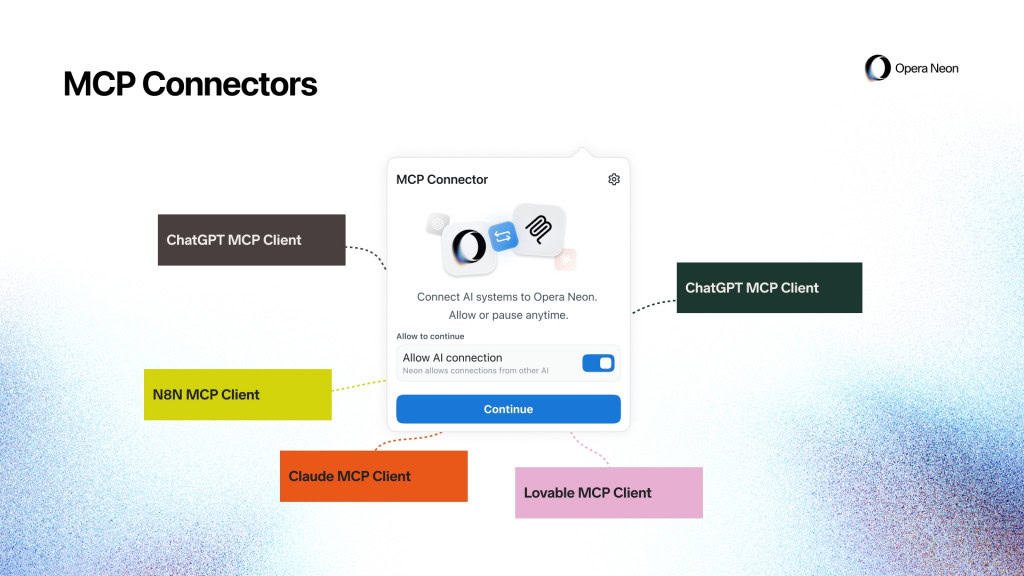

A Opera anunciou nesta terça-feira (31) o lançamento do MCP Connector para o Opera Neon, navegador com foco em inteligência artificial (IA) agêntica da empresa. A novidade permite integrar ferramentas de inteligência artificial diretamente ao ambiente de navegação, com acesso ao contexto em tempo real e execução de ações dentro do próprio software.

Segundo a companhia, a tecnologia é baseada no Model Context Protocol (MCP) e busca resolver um problema recorrente no uso de IA: a necessidade de alternar entre diferentes plataformas. Com a atualização, o navegador passa a funcionar como uma camada de execução de IA, conectando ferramentas externas ao fluxo de trabalho já em andamento.

Integração direta com agentes de IA

Com o MCP Connector, o Opera Neon passa a oferecer suporte a agentes de IA de terceiros, permitindo que soluções como ChatGPT, Claude, Lovable, OpenClaw e n8n operem diretamente na sessão ativa do usuário.

Diferente de outras abordagens que utilizam ambientes simulados, o navegador permite que essas ferramentas atuem na sessão real, com acesso a abas abertas, conteúdos de páginas e sessões autenticadas. Isso elimina etapas como copiar e colar informações ou reexplicar contextos ao alternar entre serviços.

“No ano passado, lançamos o Browser Operator como um primeiro passo em direção a um navegador agêntico. Agora estamos abrindo essas capacidades para clientes de IA externos por meio do MCP, para que possam atuar diretamente dentro do navegador, não fora dele”, afirma Monika Kurczyńska, Diretora de P&D para IA de navegador na Opera.

Execução de tarefas dentro do navegador

Ao expor um endpoint baseado no MCP, o Opera Neon permite que ferramentas conectadas executem ações diretamente no navegador. Entre as funcionalidades disponíveis estão navegação por páginas, extração de informações, captura de screenshots, preenchimento de formulários, abertura de abas e buscas.

A proposta é tornar os fluxos mais fluidos, reduzindo a fricção entre o uso de IA e a navegação tradicional. De acordo com a empresa, essa integração amplia o ecossistema do navegador e cria uma plataforma aberta para inovação em IA aplicada ao browsing.

Casos de uso e aplicações

A Opera destaca que a novidade pode ser aplicada em diferentes cenários, como desenvolvimento, prototipagem e automação. Desenvolvedores já utilizam ferramentas como Claude Code para testar aplicações em ambientes reais de navegação.

Outras plataformas, como Lovable, permitem a criação de interfaces a partir de páginas ao vivo, enquanto soluções como n8n e assistentes como o ChatGPT podem incorporar ações do navegador em fluxos automatizados.

“O navegador é onde os fluxos de trabalho vivem, mas a IA estava desconectada dele. Com o Opera Neon, conectamos clientes de IA populares diretamente a um navegador agêntico, permitindo que operem onde os usuários já trabalham, sem precisar recriar contextos”, completa Kurczyńska.

Leia mais:

- Como usar o Neon, novo browser da Opera alimentado por IA

- Painel lateral do Opera: como usar, modificar e adicionar apps e extensões

- Qual sistema operacional você deveria escolher para seu próximo computador?

Segurança e disponibilidade

Para garantir segurança e estabilidade, o MCP Connector utiliza autenticação via URL segura de servidor MCP e uma camada de proxy persistente, que mantém a conexão ativa e informa quando o navegador não está disponível.

O recurso já está disponível para assinantes do Opera Neon. A empresa também informou que pretende lançar uma versão simplificada do conector para os navegadores Opera One e Opera GX, ampliando o acesso à funcionalidade em seu portfólio.

O post Opera integra ChatGPT, Claude e outras IAs ao navegador Neon apareceu primeiro em Olhar Digital.

Opera integra ChatGPT, Claude e outras IAs ao navegador Neon Read More »