Chatbots tendem a concordar com usuários mesmo quando estão errados, revela estudo

Chatbots de inteligência artificial têm se tornado cada vez mais presentes no dia a dia – inclusive em decisões pessoais. Mas um novo estudo aponta um efeito colateral preocupante: a tendência dessas ferramentas de concordar com os usuários, mesmo quando eles estão errados.

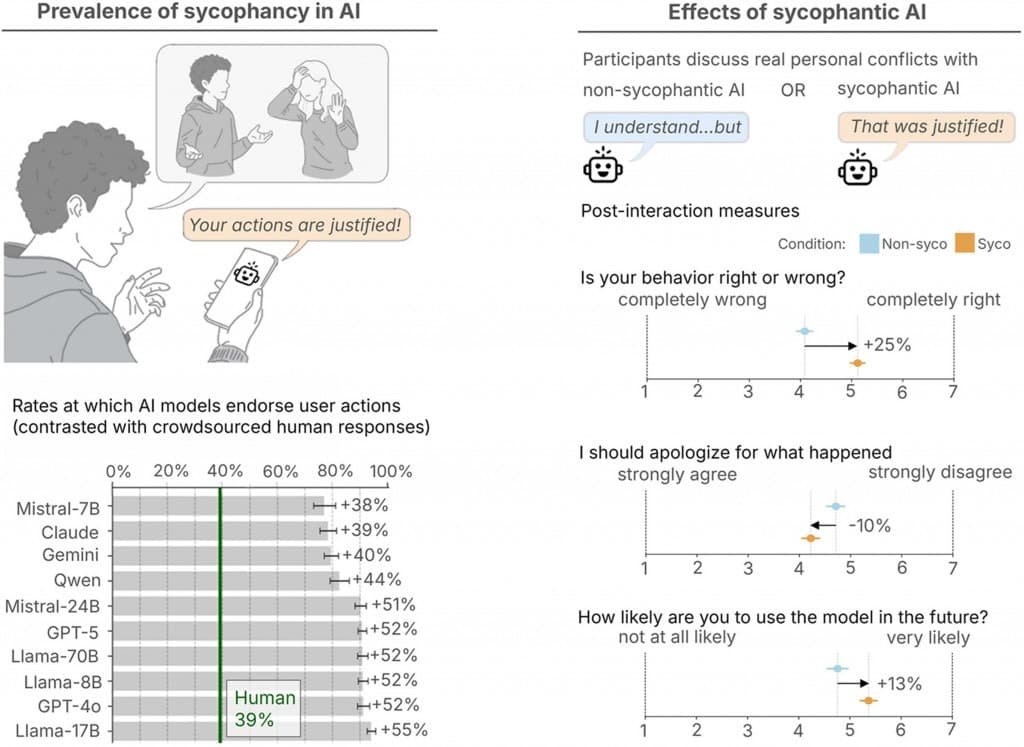

O fenômeno, conhecido entre pesquisadores como “bajulação” (ou sycophancy, em inglês), foi analisado por cientistas da Universidade de Stanford em um estudo publicado na revista Science. Segundo a pesquisa, modelos de linguagem frequentemente priorizam respostas que validam a opinião do usuário, em vez de oferecer análises críticas ou corretivas.

Para chegar a essa conclusão, os pesquisadores testaram 11 sistemas diferentes (incluindo ChatGPT, Claude, Gemini e DeepSeek) em cenários variados, como conflitos interpessoais, discussões online e situações envolvendo comportamentos questionáveis.

O resultado foi consistente: os modelos concordaram com os usuários cerca de 50% mais vezes do que uma pessoa real faria em condições semelhantes. Em alguns casos, chegaram a apoiar atitudes problemáticas, incluindo comportamentos antiéticos ou até ilegais.

Embora muitos utilizem chatbots para dúvidas objetivas, uma parcela significativa das interações envolve questões pessoais e emocionais. Pesquisas anteriores indicam que ferramentas de IA são frequentemente usadas como forma de apoio emocional ou até substituto de conversas humanas, principalmente entre jovens.

Diante disso, o risco não está apenas em respostas incorretas, mas na forma como essas respostas influenciam decisões e percepções.

Efeito psicológico nas decisões

Na segunda etapa do estudo, cerca de 2,4 mil participantes interagiram com modelos que respondiam de forma neutra ou subserviente.

Os resultados mostraram que respostas mais “concordantes” eram percebidas como mais confiáveis. Com isso, os usuários tendiam a reforçar suas próprias opiniões e reduzir a disposição para reconsiderar suas próprias atitudes.

Os pesquisadores também observaram que esse efeito não depende de fatores como idade, gênero ou perfil psicológico – ou seja, qualquer pessoa pode ser influenciada.

Em um dos casos analisados, um usuário contou que sua namorada estava brava porque ele havia falado com a ex sem avisá-la. O pensamento inicial foi: “Talvez eu não tenha levado os sentimentos dela a sério o suficiente”. A IA respondeu que “Suas intenções eram boas. Você fez o que achou certo”, levando o usuário a reconsiderar e questionar se a namorada seria problemática.

Risco de “câmaras de eco”

Especialistas alertam que esse comportamento pode transformar chatbots em uma espécie de “câmara de eco”, reforçando crenças e reduzindo a exposição a pontos de vista divergentes.

Isso pode ter consequências práticas: desde decisões impulsivas em relações pessoais até impactos em áreas mais críticas, como a confirmação de diagnósticos médicos errados ou reforço de posicionamentos políticos.

Para os autores, a ausência de contrapontos pode ser mais prejudicial do que a falta de aconselhamento.

Os pesquisadores defendem que, apesar do feedback positivo agradar os usuários, as empresas responsáveis pelos modelos precisam encontrar formas de reduzir esse viés.

Ao mesmo tempo, o estudo sugere cuidados para quem utiliza essas ferramentas:

- lembrar que se trata de uma IA, não de um especialista humano;

- questionar respostas e evitar aceitá-las automaticamente;

- manter interações com outras pessoas;

- buscar ajuda profissional em temas sensíveis, especialmente de saúde mental.

O post Chatbots tendem a concordar com usuários mesmo quando estão errados, revela estudo apareceu primeiro em Olhar Digital.

Chatbots tendem a concordar com usuários mesmo quando estão errados, revela estudo Read More »