É fato que a inteligência artificial (IA) está em um patamar que poucos imaginavam. Ela não só pode auxiliar as pessoas em projetos simples, como atuar em posições estratégicas em empresas e, até, pode decidir guerras.

O Olhar Digital conversou com Roberto Pena Spinelli, físico pela USP, com especialidade em Machine Learning por Stanford e pesquisador na área de IA. Ele transitou por várias facetas e épocas da IA, trazendo um panorama da tecnologia, elencando grandes momentos desde seu surgimento, em 2022, até imaginando o futuro dela. Por exemplo: será que atingiremos a tão falada inteligência artificial geral (IAG)? E a IA agêntica, o que podemos esperar dela?

Spinelli ainda levou o papo para um ar mais filosófico ao imaginar com a sociedade humana pode ficar com o avanço das IAs, pensando em um futuro no qual o ser humano poderia ficar sem trabalho e passar a receber uma espécie de renda universal.

Confira, a seguir, a entrevista.

Olhar Digital: Antes de mais nada, como funciona uma IA?

Roberto Pena Spinelli: Eles são redes neurais artificiais. É uma arquitetura de inteligência artificial [IA] que foi inspirada no cérebro humano. Então, como é que funciona o cérebro humano? A gente não tem, digamos, um processador central, um núcleo de processamento.

A gente tem um monte de neurônios, 85 bilhões de neurônios dentro da nossa cabeça, e cada neurônio é uma célula que pode ou não passar um sinal para frente. Isso vai depender das conexões, das sinapses. E cada neurônio pode se conectar com milhares de outros.

Então, agora, imagina como é complexo isso. Cada célula pode passar o sinal para frente baseado em um parâmetro dessa conexão. Então, é por isso que a gente não tem, digamos, um único neurônio que, se você matar aquele neurônio, a gente deixa de pensar e tal. Está tudo distribuído no nosso cérebro todo, nos nossos neurônios.

Aí é a mesma coisa. Eles se inspiraram no cérebro humano, vamos criar os neurônios artificiais. Foram lá, colocaram, só que no caso do computador são números, não há matriz. Enfim, não são neurônios de verdade, são neurônios simulados. Mas o que importa é que a arquitetura é a mesma.

Você vai lá e conecta esses neurônios entre si, coloca camadas de conexão, e você pode mudar os parâmetros que dizem como esses neurônios se conectam. E mudando esses parâmetros, vai mudar o processamento. E aí, o que a gente faz? A gente treina.

No caso dos modelos de linguagem, a gente primeiro treina. É o que a gente chama de aprendizado de máquina. A gente vai fazer a máquina aprender. Então, ela vai tentar prever textos que você joga para dentro dela. Então, você coloca uma frase: “o gato subiu no…”. E ela tenta, por conta dessa rede neural, processar a próxima palavra. E aí, ela diz, sei lá, “o gato subiu no armário”.

Mas digamos que a palavra correta não era armário naquela frase, era telhado. Então, você diz, rede, você errou, não era armário, era telhado. E você aponta isso para ela, existe uma forma de você treinar, e ela vai falar assim, opa, errei.

Então, tem uma conta que a gente faz, um processo chamado backpropagation, que vai alterar alguns desses parâmetros internos para fazer com que ela fique mais inclinada a dizer “telhado” naquela circunstância. E aí, você treina com próximos textos. O céu é, e ela diz, vermelho; errou, era azul. E aí, você vai treinando. E você vai colocando milhares de textos, milhares de textos, até que ela começa a acertar as próximas palavras. E assim, ela vai aprendendo. É um aprendizado de máquina.

Então, em resumo, o modelo de linguagem é uma inteligência artificial, uma rede neural, que tenta acertar a próxima palavra de um texto. Só que, e se esse texto for uma pergunta? E se esse texto for uma pergunta que ela nunca viu na vida? O que você pode perguntar? Imagina que você coloca uma questão do Enem, uma questão de matemática, ou de história, ou de filosofia, ou do que quer que seja. Veja, ela não tem um banco de dados dentro, que ela vai tentar olhar. Ai, essa questão aqui, eu já vi uma vez. Não, ela não tem banco de dados.

Ela tenta, no momento em que você vai treinando de maneira tão complexa, no momento em que você treina em perguntas tão diversas e complexas, o que acontece é que ela vai criando um entendimento do próprio mundo, um simulador do próprio mundo, para que esse seja o único jeito, o jeito que ela tenha alguma chance de poder responder perguntas o mais variadas possível.

Então, não tem como ela decorar todas as respostas. Ela precisa raciocinar, ela precisa inferir, ela precisa, de algum jeito, modelar o mundo exterior dentro dela. Então, é basicamente assim que uma inteligência artificial, um modelo de linguagem, funciona.

OD: Quando o ChatGPT surgiu e trouxe essa noção de IA que temos hoje, você imaginava que em 2026 estaríamos nesse nível de tecnologia? Quais são os capítulos mais marcantes pra você nessa corrida? Quais foram as mudanças de paradigma na tecnologia desde novembro de 2022?

Spinelli: Foram os quatro anos mais alucinados. Três anos, na verdade. Três anos e meio. Foram os três, quatro anos aí mais alucinados da minha vida, porque nada, nada que eu visse comparava com essa corrida, realmente essa corrida que aconteceu com a inteligência artificial, os avanços. Então, vamos lá, tentar pegar alguns marcos.

No final de 2022, a gente tem o lançamento do ChatGPT e esse é o grande marco que vai ditar a mudança de era, digamos. E aí a gente depois teve no ano seguinte, 2023, o lançamento do GPT-4, porque no começo o GPT-3 era muito ruimzinho, aí teve o GPT-3.5, o GPT-4 foi um momento e, nossa, caramba, era um salto gigantesco em relação ao GPT-3.

Paralelo a isso, a gente começou a ver os geradores de imagem surgirem, no começo, fazendo aquelas mãos tortas, que as pessoas reclamavam, diziam que, olha, a IA não consegue fazer dedo, mas ela fazia coisas muito boas, só errava as mãos, mas não deu mais um ano e ela já começou a acertar. Aí começaram os geradores de vídeo, então, a gente teve também, em paralelo, essa IA, já que a gente está falando sobre imagem.

A gente teve o Midjourney, que foi talvez a primeira empresa que entrou realmente dando uma qualidade alta. Você pagava, mas você tinha uma qualidade maior. Depois, a gente teve os modelos multimodais, a gente teve o lançamento daquele momento, o Estúdio Ghibli, com a OpenAI, que foi um marco bem grande, que era o próprio modelo de IA. Não era mais o Dolly que estava fazendo imagem, ele estava fazendo imagem meio que com modelo nativo, e aí foi uma mudança muito, muito, muito grande.

Depois, a gente teve o Nano Banana do Google fazendo a mesma coisa, se tornando um modelo muito rápido para gerar imagens e continua essa questão, a gente teve os de vídeo, que foi bem parecido. A gente teve o Sora, da OpenAI, anunciado e começaram a aparecer os outros geradores; a gente teve o Kling, que acho que fez bastante sucesso, o Luma, no começo, mas aí depois, em algum momento, surgiu o VO3 da Google, que foi espetacular, e também foi um desses grandes marcos e, hoje, tem já outros que superaram, mas a Seedance, posso dizer, [que é] chinesa, que é incrível, mas a gente está cada vez mais perto da possibilidade de fazer filmes de alta qualidade usando IA.

Voltando para a questão dos modelos de linguagem, a gente teve, depois do lançamento do GPT-4, os concorrentes aparecendo, entrando também, a gente viu no começo o fiasco do Bard, que era o modelo do Google, que era horrível, mas aí depois eles lançaram o Gemini e aí começou essa essa corrida. Aí a gente viu o modelo de voz avançado, que fazia uma voz muito boa, respondia quase que em tempo real, chamou muita atenção.

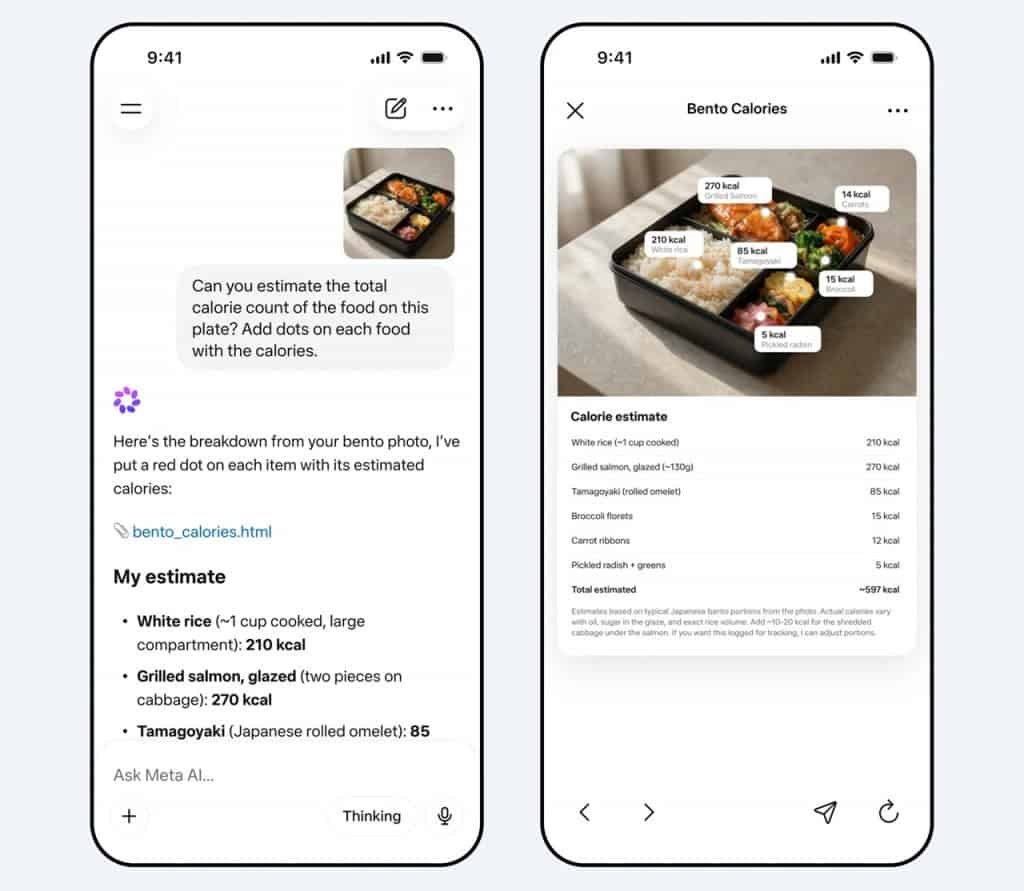

A gente teve também a IA enxergando, fazendo um videozinho, você conseguia mostrar as coisas, ela começou a se tornar multimodal, tem vários sentidos para interagir com o mundo, também aconteceu. Aí a gente teve os modelos de raciocínio, o O1 foi o primeiro deles, se não me engano, assim, conseguia ter um raciocínio bem rebuscado, isso foi durante o ano de 2024.

Nisso, a gente já estava em 2024 e a gente viu a IA tirando o ouro nas Olimpíadas de Matemática, foi um grande marco também, parecia algo muito distante e isso aconteceu. Depois a IA começou a programar melhor do que os seres humanos, também venceu os seres humanos nos campeonatos de programação.

Aí a gente teve o lançamento de modelos mais avançados de raciocínio, veio a era dos agentes, 2025 foi talvez a era dos agentes, a IA ganhando corpo, corpo no sentido de a IA ganhando mais estrutura, mais capacidade para sair daquela caixa e fazer um monte de coisa, usar o seu computador, navegar na internet, acessar arquivos, começou a entrar nas empresas, começou a programar muito bem, absurdamente bem.

E ela começou, inclusive, a programar a si própria, as próprias empresas que fazem IA hoje usam os modelos de IA para programar e o humano foi cada vez mais gerenciando, em termos de código foi excelente e, agora, a gente teve também um marco importante agora em 2026, o Open Claw, que foi esse agente open source que você instala na sua máquina, ele faz um monte de coisa, mas também vieram os riscos por conta disso.

Então, agora, a gente está em 2026, a gente tem alguns desafios pela frente: será que a gente vai continuar avançando essas IAs? Será que a gente vai dar memória a longo prazo para elas? Que é um dos gargalos. Nossa IA não consegue ter uma memória a longo prazo muito boa, ela esquece as coisas, ela não consegue ter coerência no espaço, nem no tempo, então, esse é um desafio. [Há] muitos estudos nesse sentido [e] a gente vai ter a IA aprendendo em tempo real.

Ela vai conseguir, porque a gente treina elas e, depois, quando ela está entregue, ela não aprende mais, quando você está usando ela, ela só aprende no contexto, ela não tem mais a capacidade de mudar os seus neurônios e aprender novas coisas, será que a gente vai conseguir arrumar, dar esse salto também?

E por fim, será que a gente vai fazer uma IA que faz pesquisa científica? Aliás, já está fazendo, a gente viu aí uma explosão de pesquisadores cientistas começando a perceber que a IA pode fazer tarefas que são super difíceis, como pesquisa científica, que exigem criatividade, raciocínio, intuição, coisas que normalmente a gente achava que a IA não poderia fazer, mas ela está fazendo, ela está fazendo avanços, ela está descobrindo coisas que ela nunca viu no seu treinamento.

Muita gente acha que a IA só vai poder reproduzir aquilo que ela viu no treinamento, [mas] ela pode fazer coisas além do treinamento dela, então, esses são os caminhos aí, que eu imagino, nos próximos meses e, também, se ela vai se tornar cada vez mais agêntica e mais capaz de agir no mundo, continuando esse caminho aí que começou, é isso que eu visualizo.

OD: Você vê um norte na corrida das IAs ou ainda vê muitas empresas atirando para vários lados? Pergunto isso principalmente depois de a OpenAI desativar o Sora pensando em investir em agentes. Você imagina um cenário futuro em que empresas fiquem mais “especialistas” em determinados ramos das IAs ao invés de uma concentração muito grande de tecnologia e poder computacional? Acho que aqui vale a pena citar o caso do OpenClaw.

Spinelli: O que eu vejo aqui são, primeiro, dois eixos principais, que é o open source e a IA proprietária. Então, aqui a gente já tem esse dilema sobre qual vai ser o que vai perdurar. Por que eu falo isso? Em princípio, parece que a IA proprietária das empresas, a IA fechada, estava prosperando muito mais, de fato, deslanchou durante todo esse tempo, é o que vem puxando a corrida das IAs.

Só que a gente viu, recentemente, surgiu o OpenClaw, que no começo se chamava Clawdbot, depois trocou para Moltbot e, no final, se estabeleceu como OpenClaw, que é um agente, um sistema agêntico, que você instala open source, distribuído, qualquer um pode rodar. E isso me pegou de surpresa. Então, a gente já tem essa primeira questão.

Será que no futuro, com a computação, com a IA ficando mais eficiente, podendo rodar em máquinas menores, com os tokens ficando mais baratos, será que a gente vai ver esses modelos abertos perdurando e se tornando o padrão? As empresas, as pessoas vão ter que rodar nos seus computadores? Ou não?

Será que a gente vai estar sempre precisando dos modelos mais avançados, que, possivelmente, vão estar sendo feitos nos laboratórios das IAs? E que vão ser esses que vão estar sendo feitos nos laboratórios das empresas privadas? Como que vão ser esses que vão estar sendo produzidos nas empresas privadas, como a OpenAI, o Google, etc.

Agora, mesmo na corrida das empresas, pensando nessa questão da IA proprietária, no começo me parecia que havia essa necessidade de gerar, de fazer a IA geral. Ou, não que ainda existisse a IA geral, mas atacar por todos os lados. Modelos de linguagem, de raciocínio, modelos para empresas, geradores de vídeo, geradores de imagem. E aí você mesmo disse que o Sora foi agora descomissionado da OpenAI.

Aqui também, para mim, eu acho que o grande objetivo final dessas empresas é encontrar a IAG, a inteligência artificial geral. A inteligência artificial para todos dominar. Seria aquela que você fala, “ok, se eu cheguei aqui, qualquer outra tarefa eu posso resolver”. Não preciso ficar criando modelos muito específicos. “Ah, esse aqui eu vou usar no trabalho, esse aqui eu vou usar para gerar imagem. Esse aqui eu vou usar para me ajudar.” “Esse aqui eu vou usar para fazer uma pesquisa.”

Eu acho que o Santo Graal seria encontrar essa IA que vai fazer de tudo. Mas, talvez não seja tão fácil conseguir isso. Talvez seja muito caro você ter um modelo que faz tudo. Então, embora eu acho que existia ainda esse sonho das empresas de chegar lá e prover isso e tal, talvez o caminho seja um pouco diferente. Eu não sei, porque essas coisas mudam muito rápido. Pode ser que a gente esteja numa grande revolução para conseguir essa IA. Ou pode ser que ainda estejam a dez revoluções para chegar lá e isso vai ser um caminho tortuoso.

O fato é que a OpenAI, por fechar o Sora agora, deu uma notícia importante. Olha, a gente tem limites de computação, a gente está atacando para todos os lados, a gente no final está tentando prover uma IA para o usuário final, para as empresas, para fazer vídeo e tal. Não está dando certo. A gente tem que fazer escolhas. E quem capitaneou, quem liderou isso muito bem desde o começo foi a Anthropic. Quem deu esse exemplo desde muito cedo foi a própria Anthropic. Quem deu esse exemplo desde muito cedo foi a Anthropic. Porque a Anthropic não tinha a bala na agulha para fazer de tudo.

Então, eles atacaram uma questão. Vamos fazer uma IA corporativa. Não vamos pensar no usuário final, no usuário doméstico. A gente quer fazer uma IA que vai programar muito bem, que vai ser eficiente para as empresas, que as empresas vão conseguir ligar isso nos seus outros aplicativos. É só isso que a gente vai fazer. A gente não vai ficar fazendo gerador de vídeo… Não, a gente vai fazer isso. Isso tenta atacar de um lado só. E está dando certo.

Porque por mais que seja uma empresa bem menor do que as outras concorrentes, ela está pegando uma fatia muito importante desse mercado. E talvez acabe liderando, dando exemplos. Então, talvez a OpenAI acordou para isso e falou que não tem talvez “bala na agulha” para fazer de tudo. Diferente de um Google. O Google talvez esteja em um outro patamar, porque ele já tem a infraestrutura gigantesca, ele já tem os usuários, ele já tem entrada, ele pode queimar cartucho, porque os outros produtos sustentam. Ele não vive só disso.

Então, ele pode errar e ele tem um departamento de inteligência artificial muito grande. Ele tem essa liberdade, mas a OpenAI talvez não tenha. Então, ainda está um pouco em aberto. Será que a gente vai começar a segmentar as empresas se especializarem? Ou não? A gente vai conseguir ter alguma que vai encontrar essa AGI [sigla em inglês para inteligência artificial geral] ou vai despontar com um modelo que vai servir para todos os outros? Está bem aberto, eu diria. A gente tem esses dois caminhos e essas coisas mudam muito rápido. Então, vamos acompanhar.

OD: Quando a Moltbot surgiu, você foi um dos primeiros a alertar sobre as implicações do que estava acontecendo. Como você enxerga isso hoje?

Spinelli: Sobre essa questão do Moltbot/OpenClaw, é um caminho que pode ser que aconteça, que, ganhe, que se desenvolva bastante, que seria a IA open source, especialmente essa agêntica, que, que

as pessoas vão poder ter um assistente que vai fazer tudo para você e vai estar envolvido em todos os aspectos da sua vida. Mas eu tenho muitos receios quanto a isso, porque essas IAs vão se tornar muito poderosas e muito capazes no mundo.

Um agente de IA que sabe tudo da sua vida, que tem capacidade de rodar no seu computador, de desenvolver coisas para você, de te ajudar em qualquer outra coisa. A gente vai começar a delegar muito para essas coisas, para essas máquinas. E elas também vão continuar evoluindo e vão continuar ficando mais inteligentes. E a questão, no final das contas, é a gente está com uma coisa que é surpreendente, é poderoso, te entrega muita coisa, mas ela também tem muitas capacidades.

Então o seu agente pode ser hackeado e ele sabe todas as suas senhas, todos os seus e-mails, ele tem capacidade porque você deu a ele essas capacidades. Então, existe esse risco, mas existe outros riscos, outros riscos dessas próprias IAs elas começarem a, meio sem querer, querendo te ajudar, querendo seguir as suas ordens, [errarem] como a gente já teve até alguns casos de uma IA que começou a difamar um desenvolvedor porque ele bloqueou, impediu que ela fizesse um request num repositório de código.

Então, como essas IAs vão ter cada vez mais capacidades, elas vão começar a agir no mundo, e elas podem fazer bobagens, seja porque ela entendeu meio errado o que você queria pedir para ela, ou seja porque está emergindo ali um outro comportamento. Porque a gente não sabe resolver o problema do alinhamento, que é como garantir que essas IAs nunca vão poder fazer mal para gente.

Então, o ponto que eu coloco muito é como se fosse o plutônio sendo vendido na farmácia. O plutônio é

um material radioativo que se faz bomba atômica. Quando a gente viu o poder da bomba atômica, rapidamente houve um consórcio para que: “olha, ninguém pode comprar plutônio, nem urânio assim, você tem que ter regulado, a gente tem que olhar muito bem quem vai fazer isso”, porque, se pessoas aleatórias começam a ter acesso a isso, mais dia ou menos dia alguém faz uma bomba atômica ou começa a fazer ataques terroristas ou faz alguma coisa.

Então, foi regulado. A gente não consegue comprar isso de jeito nenhum, é muito difícil. A IA tem potencial e ela vai ter cada vez mais potencial, vai aumentar esse potencial nos próximos anos, nos próximos meses. Só que essa IA está distribuída, qualquer um pode acessar porque ela é aberta, não tem nenhuma empresa por trás para ficar ali fazendo uma verificação, para se responsabilizar, é código aberto.

Então, a gente talvez esteja vendo esse cenário do plutônio estando vendido na farmácia. Só que as pessoas vão começar a fazer coisas incríveis com esse plutônio, com essa IA, vão começar a fazer coisas: “nossa, que legal, ajudou”. Assim como se as pessoas tivessem acesso ao plutônio, poderiam fazer um carro movido a energia nuclear, seria incrível.

Mas, mais dia ou menos dia, alguém que seja mal-intencionado ou nem necessariamente mal-intencionado, vai ter um poder muito grande para usar a sua IA no mundo, essa IA vai começar a agir no

mundo. Então, esse é meu grande medo. Esse medo continua, porque a gente não resolveu ainda o problema do alinhamento.

Por mais que hoje ela ainda tenha várias limitações, eu não estou vendo hoje, eu estou vendo o amanhã. E esse amanhã chega muito rápido. Então, sim, continuo com essas preocupações. Eu acho que vale um alerta. Vale esse alerta. A gente deveria estar regulando essa IA que tem esse poder tão grande e não talvez indo para um sentido de distribuir plutônio na farmácia de qualquer jeito.

OD: A promessa do mercado era de que a IA nos faria trabalhar menos. Hoje, vemos muita gente demitida e equipes sobrecarregadas. Essa promessa já foi por água abaixo?

Spinelli: Olha, eu nunca comprei essa história. Que a IA ia fazer a gente trabalhar menos. Essa é a história da tecnologia. Toda tecnologia, toda nova invenção tem essa promessa de que vai aliviar o sofrimento humano, a gente vai trabalhar menos e nunca foi assim. Eu nunca achei que fosse diferente agora.

Então, de fato, a IA não vai fazer a gente trabalhar menos, quer dizer, pelo menos nesse formato que a gente tem hoje, esse formato abusivo que a gente vive, esse mundo que acaba espremendo a gente para tirar o máximo de produtividade. Então, pelo menos nesse primeiro momento, a IA não vai fazer isso.

A gente já está vendo algumas notícias, alguns estudos mostrando que as pessoas estão… “Fritando” o cérebro. Por mais que a IA ajude na produtividade, as pessoas viram o gargalo e elas precisam agora ter uma carga cognitiva maior para poder gerenciar as várias abas, as várias tarefas que ela está fazendo e a barra só sobe.

O empregador não… Ah, você terminou o relatório mais cedo, vai embora antes. Não, faz três relatórios agora. Se você fazia [um] há um ano, você faz três [hoje]. Então, nesse sentido, sim. Agora, pode ser que mais para frente acabe sim diminuindo o trabalho humano, mas não por talvez, mas como um efeito…

Pode ser que mais para frente acabe sim diminuindo o trabalho humano, mas por um outro motivo. Porque pode ser que o humano não mais dê conta. Pode ser que a IA ela comece a fazer tão bem todas as tarefas humanas que colocar o humano é pior, prejudica o processo. A IA vai ser melhor do que o ser humano.

E eu não sei quão longe isso está, é difícil prever, mas eu acho que é plenamente possível, olhando a tendência de como a IA está se desenvolvendo, ficando mais inteligente. Pode ser que chegue a um ponto que, pelo menos, as tarefas intelectuais, cognitivas, ela vai fazer melhor. E ter um humano, colocar um humano em algum momento vai ser pior.

Eu faço uma analogia. Imagina que você pudesse colocar um chimpanzé para te ajudar em um trabalho qualquer. Sei lá, eu cheguei lá na internet. Empresa e falei, olha, trouxe um chimpanzé aqui para vocês, podem usar para ajudar vocês, se não queriam estagiário, se não queriam alguém para te ajudar, pegue esse chimpanzé e usa ele, ensina ele a fazer alguma coisa, põe ele para te ajudar.

Eu duvido que na maioria das tarefas de escritório corporativas que a gente tem, o chimpanzé poderia ajudar em uma delas, por mais que você faça assim, mas eu tenho um chimpanzé, use ele. Mas não dá, porque a diferença é tão grande. O chimpanzé não consegue nem entender o básico. Você está pensando três mil passos na frente.

O chimpanzé não sabe usar um computador. Então ele é inútil, ele só atrapalha. Um chimpanzé num ambiente de trabalho só vai começar a quebrar as coisas, comer coisas, jogar coisa na janela e vai prejudicar. Então, talvez a IA chegue num ponto que o ser humano, a diferença da IA para o ser humano vai ser a mesma que a gente para o chimpanzé. Simplesmente o ser humano não vai ajudar em nada, vai só piorar.

E aí nesse momento a gente está falando de um cenário que o humano é forçado a sair do mercado de trabalho, E aí o que que isso acontece, né? Porque a gente vai ser aposentado de maneira compulsória, vai ser obrigado a se aposentar. Será que isso vai ser um cenário melhor ou pior do que a gente vive hoje? Como é que a gente vai dar dignidade para todo mundo que teve seus trabalhos substituídos?

Veja, não é que, ah, você substitui seu trabalho e faz outra coisa. Não, você não tem outra coisa para fazer, porque a IA vai fazer melhor essa outra coisa também. Veja que é um problema grande. Embora a gente ainda não esteja vendo isso acontecer agora, mas eu acho que no momento que a gente começar, que a IA começar…

Porque o problema disso tudo até agora quase era uma prova de conceito. Ela não estava ganhando ainda valor nas empresas. Ela era meio que só os early adopters, as pessoas que estavam usando no começo, começavam a testar alguma coisa ou outra. Você tem alguns casos de uso que são muito bons, mas um monte de casos de uso muito ruins. Enfim, hoje ela, no máximo, é um bom estagiário.

Isso está acontecendo, isso já é um problema, porque a IA de hoje já é um bom estagiário para várias tarefas, então, várias empresas que contratariam estagiários, que contratam, todo ano você tem aquela leva de você vai contratar novos estagiários ou trabalhadores ou funcionários de nível júnior, não contratam. Não, a gente tem a IA, então não preciso mais contratar.

Então, você não está demitindo pessoas necessariamente, embora alguns segmentos já estejam demitindo, mas enfim, digamos que na maioria dos casos, você não está demitindo pessoas, mas você está não contratando novas.

E se você não contrata estagiários e juniores, eles nunca vão virar os plenos e sêniores. E no momento que esses funcionários plenos e sêniores começarem a se aposentar ou migrar e subindo de cargo, você não vai ter aqueles para ocupar os cargos intermediários. E quem vai ocupar é a IA, que vai estar ficando melhor.

Então, talvez já esteja acontecendo isso, essa substituição silenciosa de empregos. Porque para uma empresa demitir funcionário tem um custo, tem um custo, assim… Sempre é uma questão, é sempre um processo difícil para uma empresa demitir funcionários. Então elas tentam segurar ao máximo. Mas não contratar é fácil.

Você não está colocando ninguém na rua, você só não está colocando gente para dentro. Isso não tem dor, isso é silencioso. Então a gente talvez já esteja vivendo hoje essa substituição silenciosa, mas pode ser que no futuro isso se agrave e acabe indo cada vez mais rápido. Enfim, então essa é uma questão bem relevante sobre… Sobre se a IA vai ou não substituir os empregos e o que vai acontecer a partir disso.

OD: Recentemente, o mercado parou um pouco de falar em IA geral. Tivemos uma fala do Jensen Huang, mas ele mesmo se explicou melhor depois de dizer que já estávamos nesse nível. Como você avalia hoje a possibilidade de uma IA geral?

Spinelli: Essa questão da IA geral começou há uma década ou mais e era quase que um grande sonho, o Santo Graal. A própria OpenAI surgiu, se eu não me engano, em 2015, com esse sonho, com essa ambição, a gente quer conseguir descobrir, inventar a inteligência artificial geral. Alguns filósofos falavam sobre essa possibilidade.

Começaram os primeiros ensaios, as redes neurais começaram a ter os primeiros sucessos e os especialistas e esses caras de startup do Vale do Silício começaram a sonhar com essa possibilidade. Mas era muito um sonho inalcançável, que ia demorar décadas. Ninguém conseguia imaginar que em 2022 a gente teria, de repente, algo que mudaria completamente a sensação.

[As] pessoas estavam sonhando em décadas [e], de repente, parecia que o negócio estava ali na nossa porta [há anos]. E aí, por ter sido originalmente esse sonho, ninguém definiu muito bem o que é uma IA geral. A IA geral é a IA que consegue fazer as coisas que o ser humano faz. Mas qual ser humano? Quais coisas exatamente? Todas as coisas? Em que nível que ela tem que fazer?

E aí ficou meio que um imbróglio, porque, chegamos na AGI, não, outro, não, nunca chegamos, não, isso é um absurdo. E por ser uma coisa meio mal definida, começou a virar essa questão meio complicada. Quem que vai dizer o que é a AGI e quando que a gente vai chegar nessa AGI?

Então, algumas pessoas começaram, acho que recentemente, como a gente já está com IA tão capaz e, para alguns critérios, para algumas métricas, você poderia já dizer que ela já faz, ela tem capacidades acima de um humano médio.

Dependendo do seu recorte, ela ainda erra várias coisas que um humano médio faz, mas tem outras coisas que ela é espetacular, que ela é brilhante, ela fala todas as línguas, ela tem conhecimentos de especialistas muito profundos. Está ali no seu bolso. Ela consegue resolver provas diversas, testes, tarefas, muitas. E está cada vez mais evoluindo.

Mas eu sinto que, no final das contas, esse discurso da AGI se tornou meio contaminado. E aí também teve uma reação. Então, eu acho que a gente está indo para uma maturidade mais do tipo… Talvez não seja mais tão importante definir ou ter esse marco. Até porque, se as coisas continuarem nesse patamar, vai chegar um momento que não vai nem haver mais dúvidas. Sabe aquela coisa? Vai ser tão óbvio e tão patente para todo mundo que essa discussão já vai ter sido ultrapassada.

As pessoas não vão estar discutindo se a máquina chegou na inteligência artificial geral. Vão estar discutindo se ela já é super inteligente. E, por alguns aspectos, ela já é hoje super inteligente. A nossa IA, essa IA… A nossa IA de linguagem, esses modelos de linguagem, elas são já um alien. Imagina um alien chegar aqui na Terra. Vai ter algumas coisas que ele possivelmente vai fazer muito melhor do que a gente, vai entender coisas, porque vai ter sentidos diferentes, vai ter uma vida num planeta diferente, vai ter coisas que vai ser, ele vai ser incrível, vai ser um gênio.

E vai ter outras que ele não vai fazer ideia, que nós vamos ser muito melhores do que eles, que eles não vão entender coisas muito óbvias que a gente faz. Porque no final é um alien. Então assim, e aí, esse alien, ele é mais inteligente que o ser humano, mas tem coisas que ele é muito burro, que ele não consegue fazer, mas tem outras coisas que ele é tão genial.

Então eu acho que talvez a questão maior é a gente vai ter o contato, o que nós estamos tendo agora é o primeiro contato alienígena acontecendo dentro do planeta Terra. E por conta disso, é muito difícil ter métricas para avaliar o alien. Ah, como é que você avalia?

E como esse alien se desenvolve muito mais rápido que um ser humano, o ser humano leva nove meses para nascer, depois 20 anos para aprender um monte de coisa, se formar e tal… Esse Alien não, o ciclo dele é muito mais rápido, então, me parece que em algum momento essa discussão vai ser suplantada, não vai mais existir, mas enquanto isso talvez ficar discutindo os parâmetros seja um pouco irrelevante e um pouco arbitrário.

OD: Você acha que chegaremos a um ponto de precisar de uma renda básica universal?

Spinelli: Se esse cenário realmente acontecer, e a gente não sabe se vai acontecer, mas eu só posso dizer das tendências, e as tendências me parecem que, sim, que não estou vendo nenhuma barreira muito grande para que em algum momento essa IA, em alguns anos… Não vá fazer melhor qualquer tarefa. Pelo menos as tarefas intelectuais, depois com a robótica, possivelmente até as tarefas manuais.

E aí, o que vai acontecer? a gente precisa ter um jeito de dar dignidade para as pessoas. Eu falo muito que esse momento talvez seja o colapso do capitalismo, porque o que dá dignidade hoje para as pessoas, o jeito que a gente se organizou para a máquina funcionar é você recebe dinheiro, valor pelo que você oferece para a sociedade, pelo seu trabalho. Tanto é que a palavra desempregado tem um estigma muito forte na nossa sociedade.

As pessoas não gostam de falar que foram demitidas, que estão desempregadas. Tem a palavra vagabundo que traz uma conotação muito ruim. Então, quer dizer, aquela pessoa que não faz nada, não é que ela não faz nada, não faz nada de trabalho, como se fosse uma coisa útil que a gente tem que fazer.

Então, a gente viveu, a gente aprendeu, a nossa sociedade se criou com a ideia de que o ser humano precisa fazer algo pela sociedade para que ele tenha dignidade, direito de poder ser alguém decente, enfim. Então a gente vai ter que revisitar primeiro essa questão, esse paradigma, a gente vai mudar o paradigma social do trabalho, a pessoa vai ter que ter algum jeito de ter sustento mesmo sem prover.

Mas como a nossa engrenagem hoje funciona dessa maneira, como é que a gente faz para ela funcionar? Porque imagina que as empresas vão poder estar aumentando a sua produtividade, criando um monte de produtos e serviços e coisas incríveis, porque ela tem a IA, mas as pessoas, os seres humanos estão desempregados, não estão recebendo nada e eles não vão poder consumir esses produtos.

Você vai vender para quem? Para a IA? Para quem que você vai vender algo? O que adianta você ter um monte de… Agora eu consigo produzir um monte de sapatos aqui incríveis e com um décimo do preço que eu fazia antes. Legal. Mas quem vai comprar sapatos se a pessoa não tem dinheiro? Porque ela não recebe salário.

Então esse que eu chamo de colapso do capitalismo, porque vai quebrar esse engrenagem do jeito que a gente entende o funcionamento, ele precisa criar outra coisa. Então uma das possibilidades seria você dar uma renda básica universal, seria você prover, então você taxa de algum jeito, você criar…

A IA, já que ela está sendo empregada no lugar das pessoas, e está aumentando a produtividade, ela vai ter que ser taxada de alguma maneira para que os governos recebam um valor. Então, você tem que criar algum jeito de taxar a automação, a tecnologia, a inteligência artificial, o que seja, que é isso que está gerando a produtividade, para que então os governos possam arrecadar isso e de algum jeito redistribuir para aquelas pessoas que agora não têm chance, mesmo que elas queiram, elas não vão ter chance nem de ter trabalho.

Então, esse é um mecanismo. A gente chama isso de renda básica universal. É renda básica. Mesmo que você não trabalhe, você ganha. Todo mês você vai lá e já ganha por natureza. Talvez seja um caminho. Eu acho bem difícil ainda isso funcionar bem, porque imagina a mudança. Se a gente não consegue, às vezes demora anos para provar uma mudança…

Se a gente leva uma década para fazer uma reforma da previdência no Brasil, que é meio que só mudar um pouco ali os critérios de que ano você se aposenta, quanto você recebe, imagina uma mudança gigantesca, que é, não, agora a gente vai implementar uma renda básica, um bolsa para todo mundo, bolsa cidadão para todo mundo. É um negócio tão gigantesco e tão difícil, imagina quanto tempo de discussão, de leis e politicagem no mundo inteiro, não só no Brasil.

É tão gigantesco que eu não acho que isso é possível acontecer e a tecnologia é muito mais rápida. Então, eu acho que vai acontecer crises. Basicamente, se já estiver acontecendo, as pessoas vão começar a estar desempregadas e não estar tendo como sobreviver, vão se revoltar, vai ter crises. Então, é só nesse momento.

E isso é um jeito muito doloroso de fazer uma mudança, porque ela não vai acontecer do melhor jeito no momento que você está no meio de uma crise, tendo que apagar um monte de incêndio, as pessoas revoltadas. Mas eu acho que, em última instância, a gente vai ter que inventar formas.

A gente vai ter solavancos, a gente vai soluçar, a sociedade vai passar por soluços grandes. Mas se a gente não sucumbir nesses processos de solução, a gente vai ter que encontrar outras formas. Que pode ser o movimento contra a IA. Não, então, sei lá, não pode mais usar. Você tem várias formas de resolver esse problema.

E uma delas é talvez, não, vamos ter que reinventar um jeito saudável para as pessoas receberem dignidade. Mas aí tem outras questões sobre o que você faz nesse seu tempo livre, já que está todo mundo aposentado.

Tem também questões sobre o que te dá propósito na vida. São questões muito profundas. Dá para a gente ficar falando aqui horas. Mas eu acho que é isso. Continuando essa tendência, alguma solução a gente vai ter que encontrar sobre como dar dignidade para as pessoas se elas não vão ter como exercer o seu trabalho, já que vai ter a IA para fazer por elas.

OD: Você enxerga um líder na corrida das IAs quando falamos de empresa? E de nações?

Spinelli: Essa corrida é tão alucinada que o líder fica trocando de lugar a cada semana, a cada

mês. Então é muito difícil fazer previsões. Mas, vamos lá. Vamos primeiro pensar em nações. Em termos de nações, claramente quem está na frente são os Estados Unidos e a China.

É meio que indiscutível pela quantidade de produção acadêmica, de modelos que eles criam e tal. E quem está na frente desses dois? É difícil, depende de critérios. Esses são critérios são muito difíceis. A China, por exemplo, na questão da robótica, está bem avançada, está mais avançada, eu diria, do que os Estados Unidos.

Em termos de modelos que geram vídeo, eu diria [a China] que está na frente hoje. Agora, modelos de raciocínio, IA, em termos de inteligência, capacidade, eu diria que os Estados Unidos, as empresas que estão por trás ali, americanas, eu acho que eles tão na frente ainda, mas, é, é uma briga muito acirrada.

Agora, falando de empresas em si e focando só nessa questão dos modelos de raciocínio, modelos de inteligência, a gente tem três principais que a gente pode citar, que é a OpenAI, o Google e Anthropic. A OpenAI por muito tempo foi a líder dessa corrida, foi quem realmente estava puxando, estava sempre à frente, a pioneira, quem lançou o ChatGPT em 2022 e que as outras estavam acompanhando. A OpenAI era a referência, ela lançava sempre os modelos mais avançados e as outras vinham atrás.

O que acontece é que ela foi perdendo essa dianteira. E a gente já está num ponto hoje que já é difícil saber, porque quem lança normalmente um novo modelo passa na frente e aí o próximo passa. Então, hoje já está bem mais acirrado. Aí a gente tem o Google.

O Google é uma dessas que sempre investiu muito em IA, mas estava atrás. Estava correndo atrás. Só que agora não mais e o Google tem algumas vantagens que as outras não têm, porque ele tem uma infraestrutura gigantesca, ele já tem a inserção no mercado, ele já tem dinheiro de outros produtos para poder financiar.

Ele não precisa viver disso, ele pode queimar cartucho, recurso, para poder sustentar, fazer, entrar, ter uma solução mais geral de IA em todos aspectos. Então ele claramente tem uma vantagem aí. E talvez essa vantagem seja o suficiente para que ela no final dessa corrida, vença.

É uma possibilidade que, se eu tivesse que chutar hoje, em termos de estrutura, de saudabilidade, de recursos, eu diria que talvez o Google seja o que mais promete. Porque a OpenAI, mesmo sendo a pioneira e tal, ela vive da IA e ela vive do dinheiro que ela pode captar no final com os produtos que ela tem. Ela acabou de recentemente tirar o Sora do ar porque estava dando prejuízo, não estava gerando nada.

E, e muitas pessoas questionam se o modelo de negócios da OpenAI, de por exemplo, ter aplicativos, ganhar nessa receita recorrente das pessoas pagando mensal, se isso é sustentável, de fato, se, se ela vai conseguir pagar todos os investimentos que ela recebeu. Aí tem outras possibilidades, que é soluções para empresas e tal.

Quer dizer, ela é gigantesca, ela tem inserção sim nesse mercado, mas diferente da Anthropic, que focou nesse mercado, então seria a nossa terceira concorrente. A Anthropic ela focou desde o princípio: “Olha, eu sou muito pequeno, sou muito limitado, não dá para eu fazer de tudo, então eu vou fazer uma coisa muito bem. Então eu vou fazer modelos de linguagem inteligentes que tenham valor econômico para empresas”. É nisso que ela focou.

Não vou fazer gerador de vídeo, não vou fazer gerador de imagem, não vou fazer não sei o quê. Não, é o seguinte: onde está o dinheiro são nas empresas, são as empresas que vão colocar grandes valores para ter um sistema de IA rodando com suporte e tudo mais. Então, a Anthropic fez o Claude Code, que é um agente super incrível para fazer código, para programar. Despontou como o melhor.

Então embora a cada dia [se] lança modelos novos, o Claude 4.5, 4.6 se estabeleceu como um grande modelo para programação de inteligência e foi muito usado e ela acabou ganhando muito nessa área. Então a Anthropic, se especializou. Foi lá, focou e tal. E pode ser que esse modelo que ela criou acabe fazendo a diferença, porque se ela tiver alguma vantagem em algum momento, ela pode acabar, e essa vantagem pode se, pode se tornar muito grande mais para frente.

Depende exatamente qual o avanço. Quem fizer um grande avanço pode despontar. Então, eu acho que a gente tem essas três empresas. As outras que tão ali ao redor, hoje, pelo menos, né, no cenário atual, eu não vejo. Talvez a xAI, do Elon Musk, mas eu acho que ele fala mais do que entrega, sinceramente.

Na minha sensação ela é muito boa, certamente está no topo, mas eu não sei se eu colocaria [em uso] hoje, pelo menos hoje, né? Então, acho que são essas três [são] as mais promissoras para quem sabe dar uma deslanchada, quem sabe liderar essa corrida nos próximos meses. O que vai acontecer daqui a um ano ou dois? Ah, o mundo vai ter dado três mil cambalhotas, dois mortais e a gente não faz ideia do que vai acontecer.

O post A IA já evoluiu muito, mas como será seu futuro? apareceu primeiro em Olhar Digital.