Google introduz recurso no Chrome para salvar e reutilizar prompts de IA

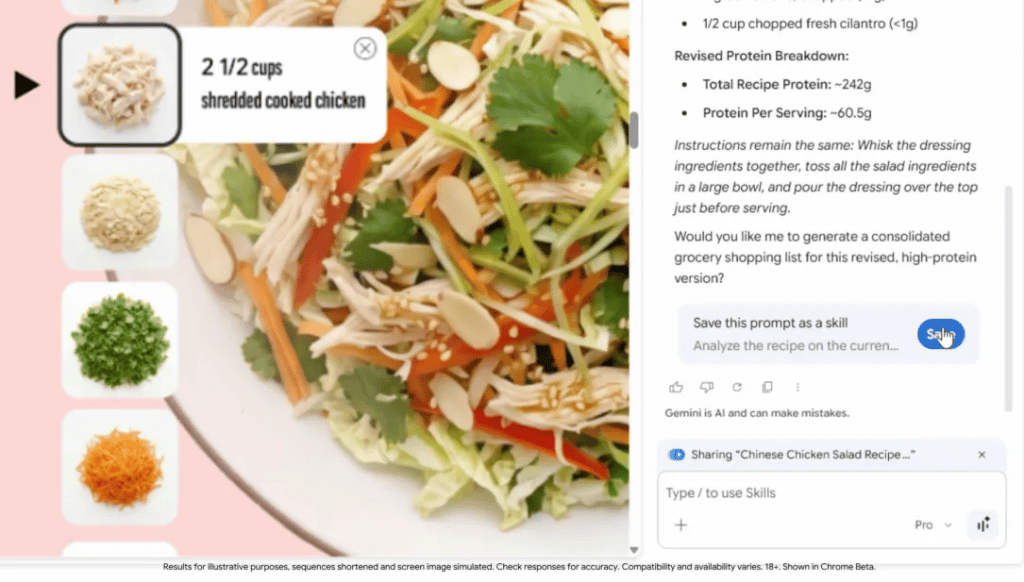

O Google anunciou, nesta terça-feira (14), a adição de uma nova funcionalidade de inteligência artificial (IA) ao navegador Chrome. Chamada de Skills, a ferramenta permite que usuários salvem e reutilizem seus prompts de IA favoritos em diferentes páginas da web, sem precisar digitá-los novamente.

A funcionalidade se integra ao Gemini, já presente no Chrome, que permite fazer perguntas sobre páginas web, resumir informações ou realizar diversas tarefas. O Skills representa um avanço ao possibilitar que prompts de IA sejam acessados repetidamente com apenas um clique.

Como funciona a nova ferramenta do Google Chrome

- Para usar o recurso, o usuário deve salvar o prompt de IA como uma Skill diretamente do histórico de chat;

- A Skill pode então ser reutilizada no Gemini dentro do Chrome digitando uma barra (/) ou clicando no botão de mais (+). A função será executada na página atual e em quaisquer abas adicionais selecionadas;

- O Google informa que as Skills podem ser editadas a qualquer momento, oferecendo flexibilidade para personalização conforme as necessidades do usuário;

- Durante os testes iniciais, a empresa identificou que os primeiros usuários utilizaram Skills em áreas, como saúde e bem-estar — por exemplo, para calcular macros proteicos em receitas —, além de comparações de compras e escaneamento de documentos extensos para resumo;

- Para facilitar o início do uso, o Google está lançando uma biblioteca de Skills com tarefas comuns em áreas, como produtividade, compras, receitas e orçamento. Os usuários podem adicionar essas Skills pré-programadas e personalizá-las editando os prompts.

Leia mais:

- Google Chrome: como criar e gerenciar perfis

- Google Chrome: como excluir todos os cookies

- Finalmente! Google Chrome estreia exibição de abas na vertical

Disponibilidade e contexto competitivo

As Skills começaram a ser disponibilizadas nesta terça para usuários de desktop do Chrome logados em suas contas Google. Inicialmente, a funcionalidade funciona apenas se o idioma do navegador estiver configurado para inglês estadunidense.

O lançamento ocorre em meio ao acirramento da competição no mercado de navegadores, com empresas, como OpenAI (Atlas), Perplexity (Comet) e The Browser Company (Dia), introduzindo alternativas ao Chrome e Safari.

Como outras ações do Gemini no Chrome, as Skills solicitarão confirmação do usuário antes de executar certas ações, como enviar e-mails ou adicionar eventos ao calendário, garantindo controle sobre as operações realizadas.

O post Google introduz recurso no Chrome para salvar e reutilizar prompts de IA apareceu primeiro em Olhar Digital.

Google introduz recurso no Chrome para salvar e reutilizar prompts de IA Read More »